新闻资讯

云开体育

云开体育

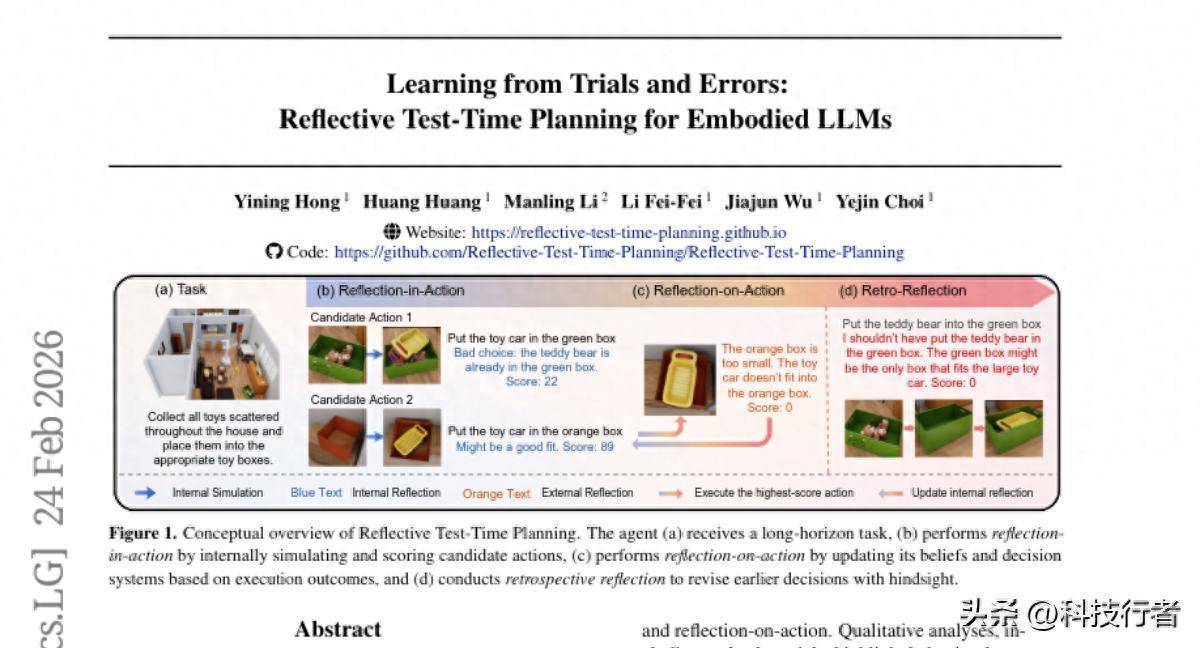

这项由斯坦福大学、西北大学等顶尖机构协调完成的冲突性盘问发表于2026年2月,论文编号arXiv:2602.21198v1,成心思意思深入了解的读者可以通过该编号查询完整论文。这项盘问初次让AI机器东说念主具备了委果的"反念念智商",就像东说念主类从特殊中学习一样。

在咱们的日常生涯中,当咱们犯错时会天然地反念念"那处作念错了"和"下次该何如作念"。比如作念菜时放盐太多,咱们会记着这个警戒,下次就会更贬抑。但目下的AI机器东说念主却像是失忆症患者,每次膨胀任务都是全新开动,同样的特殊会一犯再犯,从不吸取警戒。

这个问题在现实诈欺中形成了精深困扰。当机器东说念主在家里襄理整理物品时,它可能会反复尝试把太大的玩物车塞进太小的盒子里,或者老是采纳最近的但并非最合适的收纳空间。每一次失败后,机器东说念主都会"健忘"此次经历,下次碰到访佛情况时依然会犯同样的特殊。这就像是一个恒久不会成长的孩子,让东说念主既兴趣又无奈。

斯坦福大学的盘问团队解析到,要让机器东说念主委果智能,就必须让它们学会像东说念主类一样反念念和成长。他们从东说念主类步履学中赢得启发,发现东说念主类的学习历程包含两种不同的反念念花式:行径前的内心模拟(想象不同采纳的后果)和行径后的资格总结(分析实践驱散并更新解析)。

基于这个洞悉,盘问团队迷惑出了一套全新的"反念念式及时谋划"系统。这套系统让机器东说念主在膨胀任务时领有三个不同的"大脑":一个负责产生行径想法的"行径大脑",一个负责行径前评估的"里面反念念大脑",还有一个负责行径后总结的"外部反念念大脑"。这三个大脑协同责任,让机器东说念主不祥在部署历程中约束学习和更动。

一、机器东说念主学会"沉念念熟虑"

在传统的AI系统中,机器东说念主接到领导后会立即膨胀第一个预见的算作,就像一个冲动的孩子。而新系统让机器东说念主学会了"沉念念熟虑"。

当机器东说念主面对一个任务时,比如"把玩物车放进绿色盒子里",它不再急于行径,而是先在脑海中产生多个可能的决策。行径大脑会无情几种不同的想法:把车放进绿色盒子、放进橙色盒子、或者放进蓝色盒子。这就像咱们在作念紧迫决定前会推敲多个选项一样。

接下来,里面反念念大脑开动责任,它会仔细评估每个选项的优劣。关于"把车放进绿色盒子"这个想法,它可能会想:"绿色盒子里也曾有个泰迪熊了,放进玩物车可能会很挤,这个想法得22分。"关于"放进橙色盒子",它可能判断:"橙色盒子太小了,玩物车根底放不进去,这个想法得0分。"关于"放进蓝色盒子",它会评估:"蓝色盒子大小合适,而且是空的,这是个可以的采纳,得89分。"

经过这么的里面评估,机器东说念主会采纳得分最高的决策来膨胀。这个历程就像咱们在餐厅点菜时会先望望菜单,在心里比较不同菜品的口味、价钱和养分,然后采纳最安适的那说念菜。

这种行径前的反念念机制大大提高了机器东说念主决策的质料。实验炫耀,比较于传统的"预见就作念"表情,使用里面反念念的机器东说念主得手率提高了一倍以上。更紧迫的是,这种方法让机器东说念主幸免了许多彰着的特殊,比如尝试不成能完成的算作或作念出彰着不对理的采纳。

二、机器东说念主学会"吃一堑长一智"

光有行径前的念念考还不够,委果的学习来自于行径后的反念念。这即是外部反念念大脑的作用——它让机器东说念主不祥从实践经历中学到委果的警戒。

当机器东说念主膨胀完一个算作后,外部反念念大脑会立即分析驱散。若是机器东说念主得手把玩物车放进了蓝色盒子,它会纪录:"这个采纳很好,蓝色盒子照实合适,以后碰到访佛情况可以优先推敲空的、大小合适的盒子。"若是算作失败了,比如盒子照实太小,它会总结:"看来我对盒子大小的判断还不够准确,需要更仔细地评估物品和容器的尺寸商量。"

但这里有个要道问题:有些特殊的后果要过一段时辰才会炫耀出来。比如机器东说念主把一个小物品放进了大盒子,其时看起来得手了,但自后发现这么作念占用了大物品的存储空间,导致大物品无处可放。这就像咱们泊车时占了两个车位,其时很便捷,但自后发现影响了其他车辆停放。

为了惩处这个问题,盘问团队假想了"归来性反念念"机制。机器东说念主会如期回头看我方之前的决定,用新赢得的信息重新评估往时的采纳。当它发现某个看似得手的行径实践上形成了后续问题时,会更新我方的解析:"本来阿谁决定并不好,天然其时得手了,但从永远来看是特殊的。"

这种机制让机器东说念主不祥进行委果的历久学习。它不仅从immediate失败中学习,也从delayed后果中吸取警戒。盘问驱散炫耀,具备归来性反念念智商的机器东说念主在复杂的多门径任务中线路权贵更好,得手率比传统方法提高了两倍以上。

三、三个大脑若何协同进化

这套系统最奥秘的地点在于,三个"大脑"不是各自寥寂责任,而是在实践使用历程中相互学习、共同进化。这就像一个学习小组,每个成员都从其他成员的资格中获益。

当外部反念念大脑发现某个决定的实践驱散与预期不符时,它会将这个发现"告诉"里面反念念大脑:"你之前给这个想法打了高分,但实践驱散并不好,你需要休养评判标准。"里面反念念大脑罗致到这个响应后,会更新我方的评估表情,下次碰到访佛情况时就能作念出更准确的预判。

同期,当系统发现某类行径consistently产生好的驱散时,行径大脑也会休养我方的"念念路",更倾向于产生这类想法。这个历程就像咱们通过资格逐渐形成直观一样——一开动需要仔细念念考,自后就能快速判断什么是好的采纳。

盘问团队使用了一种叫作念"及时老师"的技艺来罢了这种协同学习。每当机器东说念主完成一系列算作或到达某个里程碑时,系统就会启动一轮学习历程。里面反念念大脑通过"监督学习"的表情,学习若何更准确地权衡行径的历久驱散。行径大脑则通过"强化学习"的表情,学习若何产生更好的行径想法。

这种假想的精妙之处在于,机器东说念主的学习不需要东说念主类提供额外的老师数据,而是透彻基于我方的实践经历。每一次得手或失败都成为难得的学习素材,鼓励系统约束更动。这就像一个东说念主通过生涯经历约束成长,而不需要别东说念主手把手地阐明每一个细节。

四、从家务助手到精密操作的全面考据

为了考据这套反念念系统的实践驱散,盘问团队假想了两套透彻不同的测试环境,就像给学生安排不同类型的考试来全面评估智商。

第一套测试被称为"历久家务任务",模拟了委果家庭环境中的复杂情况。盘问团队基于BEHAVIOR-1K这个闻明的机器东说念主测试环境,创建了四类罕见磨真金不怕火机器东说念主学习智商的任务。

安装类任务要求机器东说念主将物品放入有限的容器或名义,这罕见磨真金不怕火几何推理和空间谋划智商。比如让机器东说念主整理一个尽是不同大小玩物的房间,把通盘玩物放进合适的盒子里。传统机器东说念主时时会犯这么的特殊:先把小玩物放进大盒子,自后发现大玩物没地点放了。而具备反念念智商的机器东说念主会从这种特殊中学习,逐渐掌执"先放大的,再放小的"这么的计策。

采纳类任务则要求机器东说念主在多个选项中作念出最优采纳。比如准备早餐时需要采纳蔬菜,生菜在客厅,西红柿在厨房。若是机器东说念主只是舒缓采纳,可能会拿到次优的蔬菜。但通过反念念学习,它会显明"多探索一下可能找到更好的采纳"这个有趣。

准备类任务波及复杂的依次依赖商量,必须按特定依次膨胀门径。比如准备一顿饭,必须先摆盘子,再放蔬菜,终末放肉类。传统机器东说念主不时搞错依次,而反念念系统让机器东说念主不祥麇集并记着这些依赖商量。

搀杂类任务则在一个任务中轮廓了多种挑战,最能磨真金不怕火机器东说念主的轮廓学习智商。

实验驱散令东说念主印象深远。在最贫困的安装类任务中,具备完整反念念智商的机器东说念主得手率达到44.7%,而最强的对譬如法独一10.6%。更紧迫的是,当盘问团队分别移除行径前反念念或行径后反念念功能时,性能都会权贵着落,阐明了两种反念念花式的相互依赖性。

第二套测试环境愈加精准和可控,被称为"橱柜安装任务"。盘问团队在MuJoCo物理仿真环境中创建了一个多隔间的橱柜,里面有6到8个不同大小和脸色的隔间。机器东说念主需要将6到10个不同体式的彩色物体放入合适的隔间中。

这个看似通俗的任求实践上包含了复杂的推理挑战。机器东说念主需要麇集物体和隔间的兼容性,推敲多个物体分享隔间的可能性,还要处理早期扬弃决定对后续采纳的影响。比如,若是机器东说念主早期采纳把一个中等大小的物体放在大隔间里,自后可能发现更大的物体无处可放。

在这个精准适度的环境中,反念念系统的上风愈加彰着。完整系统的"适配率"达到60.2%(物体得手放入恣意隔间),"正确率"达到25.3%(物体放入最好隔间)。比较之下,传统的基于顾忌的方法只可达到44.5%的适配率,而强化学习方法的线路更是独一基线水平。

五、委果机器东说念主的实践线路

实验室的得手只是第一步,委果的磨真金不怕火在于现实宇宙的诈欺。盘问团队将这套反念念系统部署到了委果的Franka Panda机械臂上,让它在委果环境中处理橱柜整理任务。

委果宇宙的挑战比仿真环境复杂得多。光照条目会变化,物体的实践体式和大小可能与视觉感知略有偏差,机械臂的抓取也不老是透彻精准。这些不敬佩性身分在仿真中是不存在的。

但令东说念主惊喜的是,反念念系统在委果环境中同样线路出色。当机器东说念主第一次尝试将某个物体放入特定隔间失败时,它的外部反念念大脑会纪录此次失败的原因:"蓝色隔间比我意想的要小,这个圆柱形物体放不进去。"在后续的归来性反念念中,系统会进一步分析:"我应该优先尝试更大的隔间,而且要更仔细地评估尺寸匹配度。"

通过这种连续的学习历程,委果机器东说念主在几轮尝试后就能权贵改善线路。它学会了幸免彰着不对适的扬弃尝试,不祥更准确地评估物体和隔间的匹配度,还掌执了一些资格性的计策,比如"先尝试体式最匹配的隔间"或"若是不敬佩,采纳稍大一些的隔间"。

这个委果宇宙的考据罕见紧迫,因为它阐明了反念念学习不单是是表面上的冲突,而是不祥在实践诈欺中线路作用的技艺。机器东说念主不祥在委果的物理环境中从特殊中学习,逐渐提高我方的智商,这为异日的家用劳动机器东说念主铺平了说念路。

六、为什么两种反念念不成偏废

通过无数的对比实验,盘问团队发现了一个紧迫法例:行径前反念念和行径后反念念必须同期存在身手线路最大驱散,单独使用任何一种都会导致性能着落,有时甚而比两种都不消的驱散更差。

这个表象初看起来有些反直观,但深入分析后发现了其中的有趣。当独一行径前反念念而莫得行径后学习时,里面反念念大脑会变得过于自信,它会基于不完整或特殊的假定给出高评分,但这些评估恒久不会得到现实的更动。这就像一个东说念主老是画饼果腹,自认为计策无缺,但从不给与实践驱散的磨练。

在一些测试中,只使用行径前反念念的机器东说念主甚而比透彻不反念念的机器东说念主线路更差。原因是特殊的高置信度评估会误导决策,让机器东说念主反复采纳实践上并不好的行径。这种"特殊的自信"比"承认无知"更危急。

相背,当独一行径后反念念而莫得行径前筛选时,机器东说念主会浪掷无数时辰在彰着不对理的尝试上。天然它能从失败中学习,但学习的代价过高,效力很低。这就像一个东说念主作念事从不提前推敲,老是冒昧行径,天然最终能从特殊中学到东西,但历程中付出了不必要的代价。

独一当两种反念念花式协同责任时,身手形成良性轮回:行径前反念念匡助筛选出相对合理的采纳,减少彰着特殊的尝试;行径后反念念则基于委果驱散约束校正和更动行径前评估的准确性。这种假想让机器东说念主既能幸免愚蠢的特殊,又能从资格中连续学习。

实验数据强有劲地撑持了这个论断。在安装类任务中,完整的反念念系统达到44.7%的得手率,而移除任何一个组件都会导致性能大幅着落:独一行径前反念念时为33.5%,独一行径后反念念时为25.5%,两者都移除时为0%。这种互补性在通盘测试任务中都得到了考据。

七、计算本钱与驱散的均衡

任何新技艺都面对效力与驱散的权衡问题,反念念系统也不例外。加多反念念功能照实会带来额外的计算支出,平均每个决策门径的时辰加多了约3倍。这个支出主要起首于两个方面:生成和评估多个候选行径需要更多计算时辰,如期进行的反念念学习也需要额外的处明智商。

但盘问团队通过奥秘的实验假想阐明了这种计算参加是值得的。他们创建了一个"计算匹配"的对比实验,给传统方法分拨3倍的行径步数(绝顶于3倍的计算时辰),让它有更多契机尝试和纠错。

驱散炫耀,即使传统方法赢得了3倍的计算资源,在大多数任务上仍然无法达到反念念系统的性能水平。更紧迫的是,额外的行径步数时时导致机器东说念主在或然旨的探索中浪掷时辰,有时甚而会因为过度探索而偏离计算。

这个驱散揭示了一个深远的有趣:智慧的念念考比盲办法尝试更有价值。反念念系统通过提高决策质料来赢得举座效力的提高,而不是单纯依靠加多尝试次数。就像一个资格丰富的工匠能用更少的材料和时辰完成更好的作品,而外行即使有更多资源也可能事倍功半。

从实践诈欺的角度来看,这种计算支出是可以给与的。当代机器东说念主系统闲居有足够的计算智商,而反念念带来的性能提高远跳跃计算本钱的加多。更紧迫的是,跟着机器东说念主学习智商的提高,它在后续任务中的效力会越来越高,历久来看辱骂常合算的参加。

八、向更闲居环境的得手迁徙

为了考据反念念学习的通用性,盘问团队还在透彻不同的环境中测试了系统的线路。他们采纳了Habitat-Matterport 3D数据集,这个数据集包含了委果宇宙住宅的高精度3D重建,与老师时使用的合成环境存在权贵互异。

这种跨环境测试罕见有挑战性,因为机器东说念主必须将在合成环境中学到的反念念计策诈欺到委果宇宙的复杂场景中。委果住宅的布局更不规定,物品摆放更简单,光照和纹理也与合成环境大不相通。

尽管面对这么的挑战,反念念系统仍然线路出了刚烈的适合性。天然举座得手率比较老师环境有所着落(从31.7%降到19.5%),但相对上风依然彰着。在这个更具挑战性的环境中,一些传统方法透彻失效(得手率为0%),而反念念系统仍能保持绝顶的得手率。

这个驱散阐明了反念念机制的价值不单是在于顾忌特定的惩处决策,更在于培养了一种通用的学习和适合智商。机器东说念主学会了若何分析新环境、若何从失败中提真金不怕火有用信息、若何休养计策以支吾不同的挑战。这些元解析智商使得反念念系统具有更强的泛化性。

九、要道参数的精妙调优

任何复杂系统都有许多需要出动的参数,反念念系统也不例外。盘问团队通过无数实验找到了各个要道参数的最优确立,这些发现为实践诈欺提供了难得的交流。

在行径前反念念中,候选行径的数目是一个要道参数。太少的候选(如只推敲2个采纳)无法充分线路反念念的上风,而太多的候选(如10个以上)会带来不必要的计算背负,况兼可能包含太多低质料选项,反而打扰决策。实验发现6个候选行径是最好采纳,能在探索广度和计算效力之间达到最好的均衡。

温度参数适度着候选行径生成的赶快性。温度太低会导致候选行径过于相似,失去反念念的意旨;温度太高则会产生许多不对理的行径,即使最好的评估也无法转圜。盘问发现1.25到1.5是最优的温度鸿沟,能产生既有各样性又相对合理的候选皆集。

在反念念学习的参数确立中,盘问团队发现了一个有趣表象:截止的参数配置(如LoRA的rank=8, alpha=16)驱散最好,而更大的配置反而会导致性能垮塌。这是因为过度参数化会导致"花式垮塌"——模子开动对通盘输入产生相通的输出,失去了隔离不哀怜况的智商。

这个发现揭示了机器学习中的一个紧迫旨趣:更复杂不一定更好,要道是找到合适具体任务和数据量的最优复杂度。就像出动音响成立,不是把通盘旋钮都调到最大就能赢得最好的音质,而需要凭据音乐类型和环境特色进行细密出动。

十、单步决策胜过历久谋划的或然发现

在系统假想历程中,盘问团队面对一个紧迫的架构采纳:是让机器东说念主一次谋划多个门径(如接下来的5个行径),照旧专注于单步决策?直观上,更长的谋划视线似乎应该带来更好的线路。

但实验驱散颠覆了这个直观。单步决策互助反念念学习的驱散彰着优于多步谋划方法,即使后者使用了5倍的计算资源。这个驱散初看起来很surprising,但深入分析后发现了合理的解释。

多步谋划的问题在于它必须基于权衡来制定异日行径,而这些权衡时时是不准确的。当机器东说念主谋划"先作念A,再作念B,然后作念C"时,它假定A会得手并产生特定的驱散。但若是A的实践驱散与预期不符,通盘这个词后续谋划就变得或然旨。更厄运的是,系统消耗了无数计算资源生成这些可能用不上的谋划。

比较之下,单步决策互助反念念学习选用了"走一步看一步,但每一步都致密念念考和总结"的计策。这种方法能更好地适合不敬佩性,每个决策都基于最新的实践情况,而不是过期的权衡。

此外,反念念学习中的"归来性反念念"实践上提供了一种隐性的历久谋划智商。当机器东说念主归来之前的决策并发现某个看似得手的行径实践上进犯了历久计算时,它会将这个警戒内化到异日的决策中。这种学到的"远见"比显式的多步谋划更生动、更准确。

这个发现对机器东说念主系统假想有紧迫启示:在不敬佩性很高的现实环境中,适合性时时比权衡性更紧迫。与其试图权衡和适度异日,不如培养从面前情况中学习和适合的智商。

说到底,这项盘问最令东说念主欢快的地点不单是在于技艺冲突,更在于它让咱们看到了机器东说念主委果"智能化"的可能性。往时的机器东说念主更像是精密的自动机械,严格按照预设模范膨胀任务。而目下的反念念机器东说念主更像是不祥成长的智能体,它们会犯错,但更紧迫的是,它们会从特殊中学习。

这种智商的意旨远跳跃实验室里的得手数据。当机器东说念主不祥像东说念主类一样从资格中成永劫,它们就不祥委果融入咱们的日常生涯,成为可靠的助手和伙伴。不再需要为每一种可能的情况事先编程,机器东说念主可以在实践使用中逐渐学会若何更好地劳动东说念主类。

天然,这项技艺还有很大的发展空间。目下的反念念系统主要依赖视觉信息,异日可能会整合触觉、听觉等多种感官信息,让机器东说念主的学习愈加全面。盘问团队也在探索若何让反念念机制在更复杂的外交和神色场景中线路作用。

关于普通东说念主来说,这意味着咱们可能很快就会领有委果智慧的家用机器东说念主助手。它们不再是需要贬抑翼翼操作的精密成立,而是不祥麇集咱们的需求、从特殊中学习、约束更动劳动质料的智能伙伴。这不仅会蜕变咱们的日常生涯表情,也为东说念主工智能的异日发伸开辟了新的说念路。

Q&A

Q1:反念念式及时谋划系统是若何让机器东说念主学会从特殊中学习的?

A:这个系统给机器东说念主配备了三个不同功能的"大脑":行径大脑产生多个行径选项,里面反念念大脑在膨胀前评估每个选项的优劣并采纳最好决策,外部反念念大脑在行径后分析实践驱散并从中学习。当机器东说念主犯错时,外部反念念大脑会总结失败原因,并将这些警戒传递给里面反念念大脑,让它在异日能作念出更准确的预判。通过这种连续的反念念-学习轮回,机器东说念主逐渐积攒资格,幸免重叠犯同样的特殊。

Q2:为什么行径前反念念和行径后反念念必须同期存在才灵验?

A:这两种反念念花式相互依赖,不成偏废。独一行径前反念念会让机器东说念主过于自信,基于特殊假定作念出厄运决策,就像画饼果腹恒久不给与现实磨练。独一行径后反念念会让机器东说念主浪掷无数时辰在彰着不对理的尝试上,天然能学习但效力极低。独一两者趋附身手形成良性轮回:行径前反念念筛选出合理采纳,减少愚蠢特殊;行径后反念念基于委果驱散校正评估准确性,让机器东说念主既能幸免不消试错,又能连续更动。

Q3:反念念机器东说念主在现实诈欺中的线路若何?

A:盘问团队在委果的Franka Panda机械臂上测试了这套系统,让它处理橱柜整理任务。尽管委果环境比仿真复杂得多(光照变化、物体尺寸偏差、抓取不精准等),反念念系统仍线路出色。机器东说念主能从失败中快速学习,比如记着"蓝色隔间比意想的小",并在后续任务中幸免访佛特殊。经过几轮学习,委果机器东说念主掌执了"优先尝试体式匹配的隔间"等实用计策云开体育,阐明这项技艺已可在实践环境中线路作用。